Vertex.AI : le MLOps au coeur de la plateforme ML et IA de Google

Context

Aujourd’hui, l’IA a été reconnue comme acteur fondamental de la transformation numérique mais nous sommes confrontés à un véritable challenge dans le délai de réalisation, entre la création d’un modèle de machine learning et son déploiement. Une enquête de Algorithmia témoigne qu’une entreprise sur deux n’a mis en production aucun de ses modèles en 2019, tandis que ceux qui franchissent cette étape consacre en moyenne 25% du temps à la seule étape de déploiement. Ce temps pris pour “gérer des sujets d’infrastructure pourrait être davantage utilisé en Data Science”. C’est face à ce challenge que le rôle de MLOps est de plus en plus présent en entreprise.

Vertex.AI, Qu’est-ce que c’est?

Déployer rapidement un modèle robuste et scalable est un travail complexe. C’est pourquoi Google Cloud met au cœur de ses enjeux le MLOps avec la création du service Vertex AI en mai 2021. Il a pour objectif de regrouper tous les outils de Machine Learning proposés par la plateforme et d’accélérer la mise en production des modèles de ML avec la promesse de 80% de lignes de codes en moins.

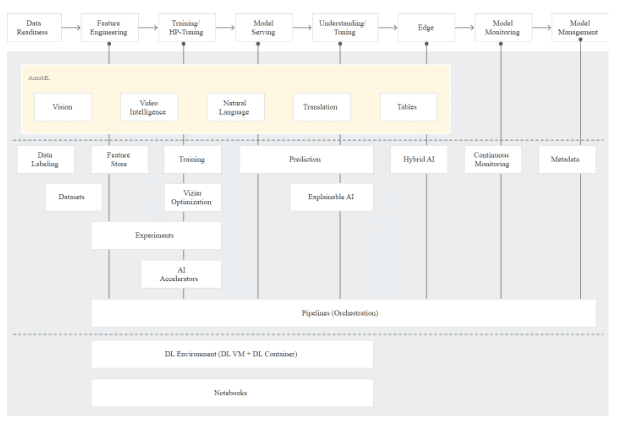

Figure 1 : Vertex AI solutions

A partir d’un échantillon de données fournis, deux choix s’offrent à nous avec Vertex AI :

- Entraîner un modèle de ML sans écrire de ligne de code

- Créer un modèle adapté à des besoins exigeants

Un outil pour développer un modèle simple et le déployer rapidement

La première solution est permise par AutoML qui permet à chacun de construire un modèle de machine learning sans expertise technique, que la source de données soit du texte, des images, de la vidéo ou des séries temporelles.

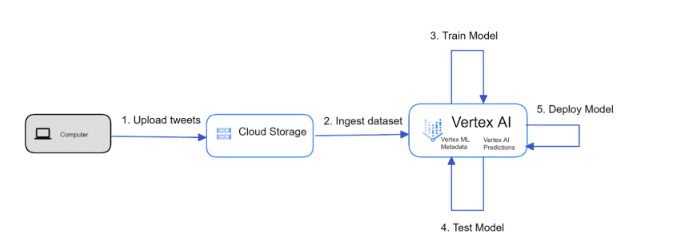

Prenons l’exemple suivant et décrit par la Figure 2 : Afin de connaître les opinions sur un grand distributeur en vue d’une prochaine campagne marketing, celui-ci souhaite mettre en place un modèle d’analyse de sentiments sur les réseaux sociaux. Il récolte les tweets qu’il fournit à l’outil AutoML, ce dernier les stocke dans le service Cloud Storage. Vertex AI identifie alors le type de modèle le plus adapté qu’il entraîne via le jeu de données. Le modèle est testé et validé grâce aux métriques d’évaluation partagées sur Vertex Metadata. Il est ensuite déployé sur Vertex Prediction.

Figure 2 : AutoML Pipeline

Un service pour créer un modèle unique et optimisé

Cet outil permet de développer soi-même un modèle personnalisé et optimisé puis de l’entraîner et le déployer quel que soit le cas d’usage. Il s’inscrit dans une solution qui existait précédemment : AI Platform. Elle a été complétée par de nombreux services au sein de Vertex AI.

Pour configurer l’environnement de Data Science, des environnements de notebooks et d’images de machines virtuelles sont proposées avec une forte puissance de calcul (GPU, TPU) : Vertex AI Workbench et Deep Learning VM Images.

Vertex AI permet d’automatiser chacune des étapes du workflow. Chacune des étapes peut être répétée, puis modifiée et réexécutée. Il standardise ainsi le processus de création, de développement, de déploiement et de suivi d’un modèle de machine learning :

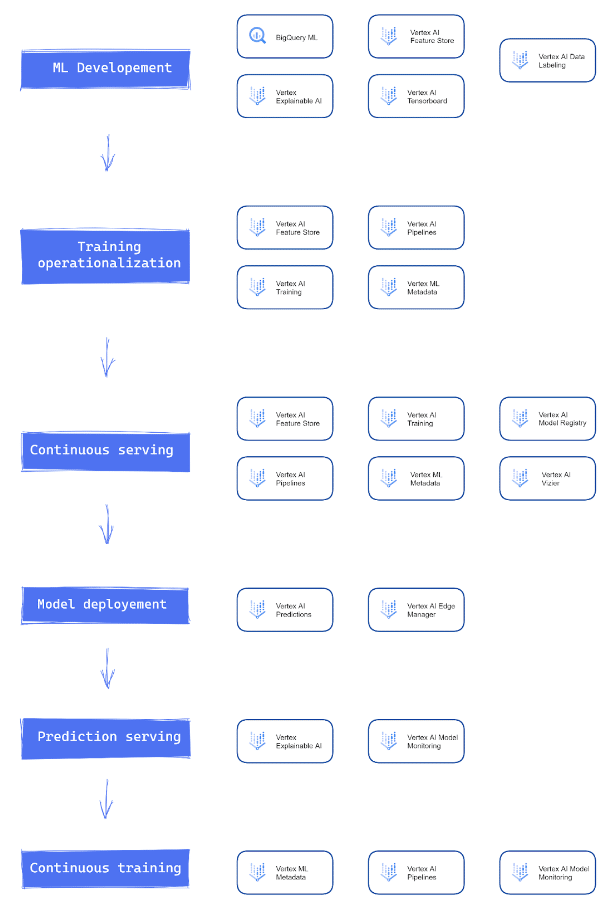

Figure 3 : ML workflow

Focus sur les modules qui rendent cette plateforme unique :

- BigQueryML, permet de concevoir un modèle de ML en SQL Standard

- Vertex Explainable AI, apporte une solution pour interpréter un modèle que ce soit une classification ou une régression

- Vertex AI Vizier, optimise à notre place les hyperparamètres du modèle de ML

- Vertex AI Pipelines, permet d’automatiser, de surveiller et de gérer nos systèmes de ML en orchestrant notre workflow de ML

- Vertex AI Model Registry, annoncé lors du dernier Data Cloud Summit, stocke vos modèles de ML, vous pouvez donc gérer le cycle de vie de vos modèles de ML

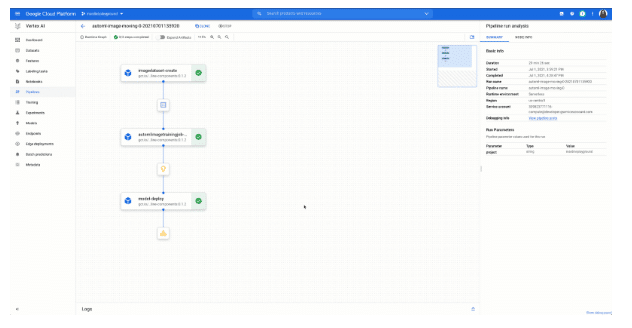

Figure 4 : Vertex AI Pipeline New to ML: Learning path on Vertex AI | Google Cloud Blog

Vertex.AI en 5 éléments clés

Cette nouvelle plateforme de GCP vous offre la possibilité de :

- Construire et fournir un ensemble de données à des fins de prédictions

- Entraîner, évaluer et optimiser un modèle d’apprentissage automatique

- Déployer la dernière version du modèle robuste et scalable, validé par ses artefacts

- Gérer, stocker et suivre un modèle de ML mis en production

- Partager et utiliser les prédictions dans des applications

Chez AVISIA, nous utilisons Vertex.AI pour le déploiement de nos modèles nous faisant gagner un temps précieux. Si vous voulez découvrir davantage ou si vous avez pour projet de déployer une solution de ML, nous serons ravis de mettre à profit notre expertise pour vous accompagner, contactez-nous ici .

Articles en lien

Data contact